人工智能技术发展神速,且越来越普及,如今只要会上网和打字,任何人都能立刻“写出”各种文案与生成逼真的影像。这种技术虽然为生活带来许多便利,但也引起更多担忧,尤其是当各国相关监管法规尚未到位。今年将有数十国举行大选,专家警告,越来越难辨别真假的深度(deepfake)伪造内容或引发一场“虚假信息海啸”,冲击各国选举和民主。

去年9月中欧国家斯洛伐克大选前,社交媒体上出现一段亲欧候选人希梅奇卡(Michal Simecka)与一名记者谈论买票操纵选举的录音。此次选举竞争激烈,这段用人工智能(AI)技术伪造的录音对选民投票意向造成多大影响不得而知,但亲俄候选人菲佐(Robert Fico)最终当选总理。

今年1月,美国民主党在新罕布什尔州举行初选前几天,许多人接到机器拨打的自动语音电话(robocall),“听到”美国总统拜登呼吁他们不要参加初选投票。新奥尔良市一名魔术师过后向媒体自爆,他只花了1美元和不到20分钟就做出这段假录音,并称是收取政治顾问克莱默(Steve Kramer)的钱办事。克莱默当时效力于拜登党内对手菲利普斯,但菲利普斯的竞选团队声称对此不知情。

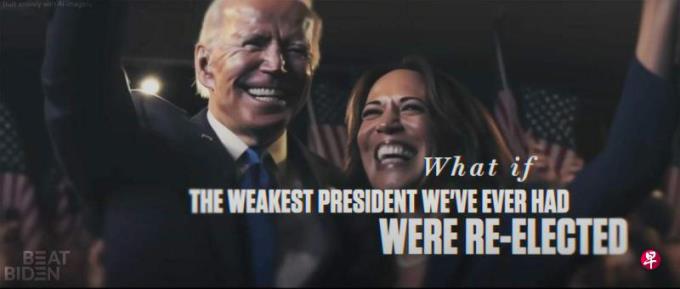

另据英国广播公司(BBC)报道,拜登的对手、美国前总统特朗普的支持者正在利用AI技术,生成与传播特朗普和非洲裔选民的合照,以鼓励黑人选民投票给他。

近期在巴基斯坦、印度、印度尼西亚等国的竞选活动中,也可以见到候选人利用AI助选,或遭以AI制作的黑材料攻击的情况。

人类识别AI生成语音 准确率只有73%

伦敦大学学院去年8月公布的研究结果显示,无论是否接受过如何识别AI内容的训练,人类识别AI生成语音的准确率只有73%。这项研究的语音样本使用相对较旧的AI工具生成,随着AI技术仿真度提升,人类的识别成功率预料只会更低。

澳大利亚国立大学去年11月发布的另一项调查还发现,被AI人脸蒙骗的人,往往对自己的判断最有信心。这令人担心,虚假信息可能在AI助力下,给各国选举和民主制度带来更大的冲击。

乔治华盛顿大学主导、今年1月发布的一份研究报告预测,到今年中,动机不良的AI活动将成为日常事件。爱尔兰科克大学教授奥沙利文(Barry O’Sullivan)预测,到了2025年或之前就会有大量证据表明,一些选举的结果受到AI宣传资料的影响。

新加坡南洋理工大学拉惹勒南国际研究院 (RSIS) 未来问题与技术研究员特拉哈诺(Karryl Kim Sagun Trajano)接受《联合早报》电邮访问时指出,AI无疑对选举构成了风险和威胁,尤其是在“真相衰退”(truth decay)的时代。“真相衰退滋生公众的不信任,并煽动了阴谋论。这种信任的侵蚀可能会对选举产生可怕后果,如选民易受虚假信息影响、选民压制和选民冷漠现象以及对选举结果的不信任,这最终可能导致选民对政府失去信任。”

假新闻当然不是新鲜事,但当生成式AI与社交媒体网络的高传播率结合,假消息将如虎添翼。

研究:对深伪内容意识提高 或破坏对真实视频信任

纽约大学社交媒体与政治中心执行主任桑德森(Zeve Sanderson)告诉《联合早报》,过去10年的研究显示,人们对假信息左右选票的担忧可能被夸大了。假信息只占一般人接触的媒体信息中的一小部分,且主要集中在少数人口群体。在美国,多数选民也早在投票日前就做了决定,不太可能临时改变主意。

不过,AI确实可能让假消息变得更普遍、更有说服力、更具针对性且更难发现。桑德森认为:“相较于是否会有更多(AI生成的假信息),更大的问题在于是否会有更多人看到(这些假信息)。”

他指出,传统的社媒平台构建在所谓的社交图上,用户看到的是在他们社交圈中流传的内容,较迟问世的Tiktok则会基于算法( algorithm),把用户社交网络以外的内容推送给他们。“这种做法正在蔓延到其他平台。由于AI使伪造视频更容易制作,Tiktok用户可能会接收到不会在其他平台上看到的虚假政治信息。”

去年10月发布的一份研究报告发现,随着人们对深伪内容的意识提高,这可能破坏他们对真实视频的信任。专家担心,随着深伪技术不断进步,人们可能再也无法分辨真假,甚至不再相信事实;那些真的做了不该做的事或说了不该说的话的人,也能以此作为开脱的借口。

桑德森以2016年俄罗斯被指干预美国选举为例指出,研究显示此事对选民的影响微乎其微,但相关媒体报道与讨论却产生了间接影响,使人们关注美国民主的脆弱,甚至开始质疑选举结果。

他说,深伪内容间接导致人们对政治体系和信息生态系统失去信心将是个问题。人们对AI的担忧“将助长所谓的说谎者红利(liar’s dividend),即利用人们对环境中充斥着错误信息的看法,把真实信息说成是假的”。

例如,特斯拉自动驾驶汽车死亡车祸、美国1月6日国会山骚乱等诉讼中,已可看到辩方声称呈堂证据是深伪的情况。桑德森说:“不难想象,今年可能会有候选人在爆发‘热麦克风’事件后,声称视频是假的。”热麦克风指的是因麦克风未关以致私下谈话被广播。

既省钱又有效 AI成竞选良策

若使用得当,AI能够帮助候选人了解选民关注什么议题、撰写宣传文案等,从而在烧钱的竞选活动中省下大量人力和成本。在2月举行的印尼总统大选中,抽样计票遥遥领先的普拉博沃竞选团队就利用AI技术宣传,包括用可爱的卡通形象,把这名铁腕将军塑造成平易近人的老爷爷。

在即将举行全国大选的印度,AI助选俨然成了一门生意。当地一名政治顾问估计,今年印度与AI相关的选举活动内容营销,包括语音通话和简讯、虚拟化身(avatar)创建、多语种社媒贴文制作等的市场规模将达到6000万美元(约8064万新元)。一些专家也认为,AI有望推进印度选举电子化进程,改变印度大选历时长、耗费大的现状。

南洋理工大学黄金辉传播与信息学院助理教授赛夫丁(Saifuddin Ahmed)接受《联合早报》访问时指出,如今政治人物越来越认识到,社交媒体作为各社会群体中一大部分人的主要政治信息来源的重要性。在政治宣传活动中利用AI生成和深伪内容,特别是通过社媒平台传播这些内容的新颖做法,能为他们带来独特优势。此外,在深伪内容中使用非正式的政治语言和叙事,能让他们显得更亲民。

他说:“要通过传统竞选手法吸引不感兴趣的人群,如较年轻的选民,与他们谈论复杂的政治问题是一个挑战。有了深伪技术,政治人物可以传播更轻松、更吸引人的内容,以创新的方式让政治更贴近这些人。”

苏哈多“复活”拉票 做法引发道德争议

赛夫丁提到,尽管还未有先例,但政党和候选人也可利用AI生成的内容,为选民提供沉浸式的感官体验,借此展示他们的能力以及与对手的区别。他强调,政治人物在竞选中使用AI虽旨在引起选民的注意,但最终目标应是逐渐地把与选民的这种互动,转化成对政治的真正兴趣和参与。

然而,在缺乏相关监管措施和法规的情况下,AI将不可避免地遭到滥用。印尼大选期间,戈尔卡党就用深伪技术“复活”前总统苏哈多,借AI苏哈多的嘴拉票。这种做法引发道德争议,以及可能影响选举公平性的质疑。

印度AI起步公司The Indian Deepfaker的老板贾敦(Divyendra Singh Jadoun)告诉半岛电视台,最近几个月他收到许多竞选团队的“不道德要求”,要他制作包括色情内容在内的虚假视频和音频来攻击政治对手。贾敦一律拒绝这些要求,但据他了解,愿意接这种活儿的大有人在,而且开价非常低。

他说:“没有任何政党认为利用AI来操纵选民是一种罪过。这不过是竞选策略的一部分。”

应对AI威胁 需全社会努力

多国政府与科技界已开始着手探讨如何更好地监管AI技术,但要有效地应对AI对选举的威胁还需整个社会一起努力。

赛夫丁受访时指出,出台完善的法律框架、写明在政治竞选中负责任地使用AI的法规至关重要。他提到,韩国国会委员会早前修法,禁止在选举前90天传播试用深伪技术制作的政治竞选视频,这是朝保护选民和维护选举进程完整性所迈出的积极一步。

其他一些国家也在探讨如何监管AI的使用。美国总统拜登去年10月签署行政命令,为AI制定新安全标准,包括要求领先的AI系统研发人员与政府分享安全测试结果等关键信息、完善相关标准和测试工具等。2023年,美国至少有15个州通过监管AI使用的相关立法或决议,但党派分裂严重的美国国会在11月大选前出台全国法案的可能性不大,即使通过法案,内容也可能不如预期有力。

桑德森建议,政府应支持有关AI引发的社会与行为后果的研究,而不仅仅是关注技术解决方案。他们也可投资于经实践后证实有效的方法,以提高公众对AI生成的错误信息的“抵抗力”,并立法规定社媒平台必须与独立研究人员共享数据。

建立信任与加强安全 社媒平台须投入更多资源

业界方面,2月16日,OpenAI、微软、亚马逊、谷歌、Tiktok、IBM、Meta、X等20家科技业巨头在慕尼黑安全会议上签署《打击在2024年选举中欺骗性使用人工智能的技术协议》。这些企业没有承诺禁止或移除深伪内容,但同意采取合理措施,对使用它们的平台制作或发布的AI内容进行探测和标签。

专家对此表示欢迎,但指科技企业还须做更多。一些因假消息泛滥而臭名昭著的网络平台也未签署这份协议,削弱了协议的成效,批评者则质疑,以利益为先的企业是否能履行承诺。

桑德森指出,社媒平台必须在建立信任与加强安全方面投入更多资源,但实际情况却相反。近期,X和Meta不仅裁员,还取消了过去为维护选举公正性而实施的一些政策。

桑德森呼吁政策制定者与企业能在这个选举年里,贯彻他们为防止滥用AI而采取的措施,以减缓AI技术在选举中的应用,让大家有时间更进一步了解AI的潜在影响。他也希望媒体通过细致入微的报道,清楚地解释AI带来的潜在风险,避免陷入围绕这种新技术的乌托邦或反乌托邦式的炒作循环。

专家担心,正在开发中或有待开发的新AI工具接下来还会带来更多未知风险。赛夫丁说:“我们看到每个月都有新的AI工具开发……防止滥用AI的保障措施能否成功,不仅取决于各机构针对AI相关威胁执行强有力安全措施的能力,还取决于公众的意识和数码素养。”

只有在政府、业界和个人都采取足够措施后,AI的威胁才可能有效地被遏制。特拉哈诺说:“行业参与者应设置护栏,防止AI助长虚假信息的传播。学者、媒体从业者和信息专业人士应该共同努力提高信息和媒体素养,特别是AI素养。政府应监管AI,同时为选举改革留下余地。”

无论如何,AI技术正迅速成为人们生活的一部分。德国弗劳恩霍夫应用集成安全研究所机器学习研究科学家穆勒(Nicolas Müller)接受《金融时报》访问时说:“这种技术将继续存在,并且会越来越好。你可能无法再下意识地相信音频或视频等媒介……我们或许不得不与它共存,就像和冠病共存一样。”